| 技術名稱 |

3D點雲視覺物件指引以及快速抓取點偵測網路 |

| 計畫單位 |

國立臺灣大學 |

| 計畫主持人 |

徐宏民 |

| 技術簡介 |

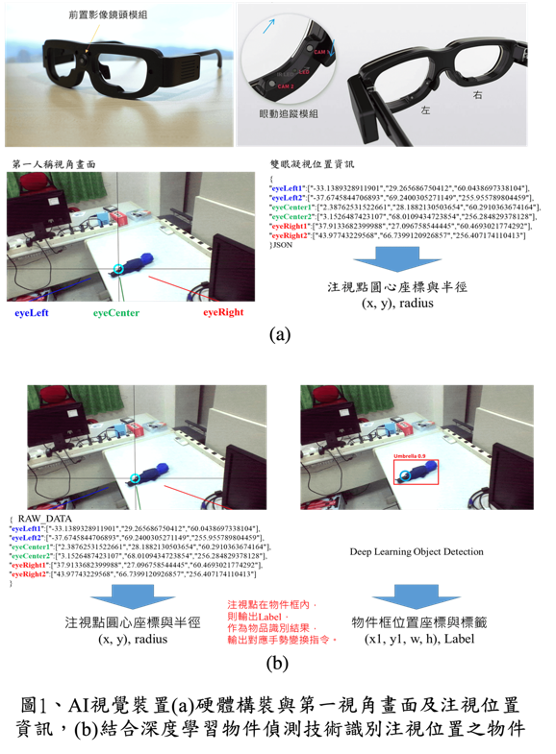

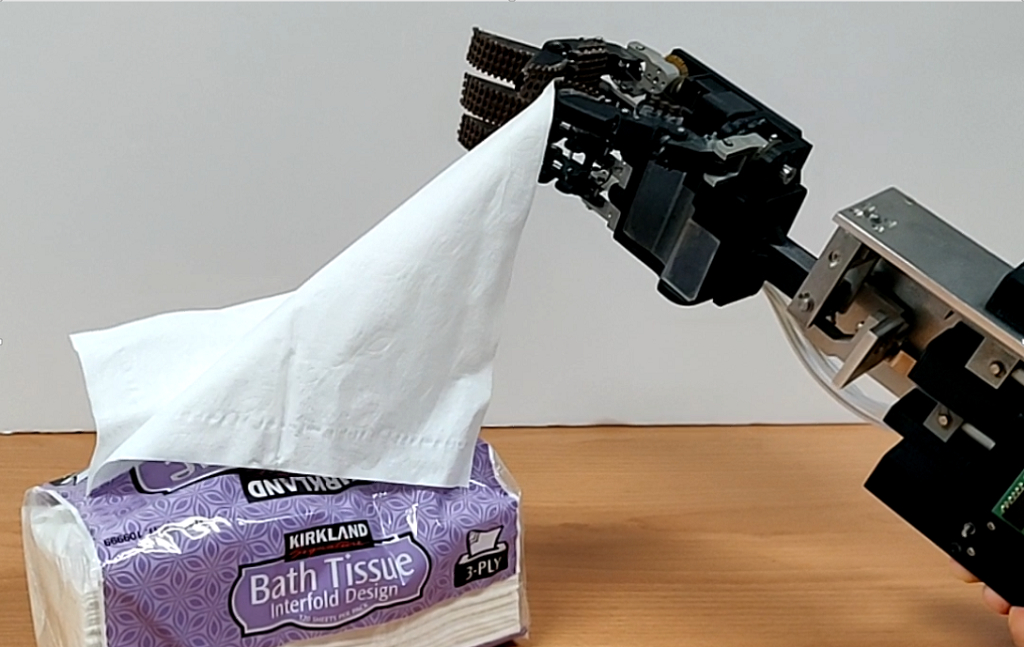

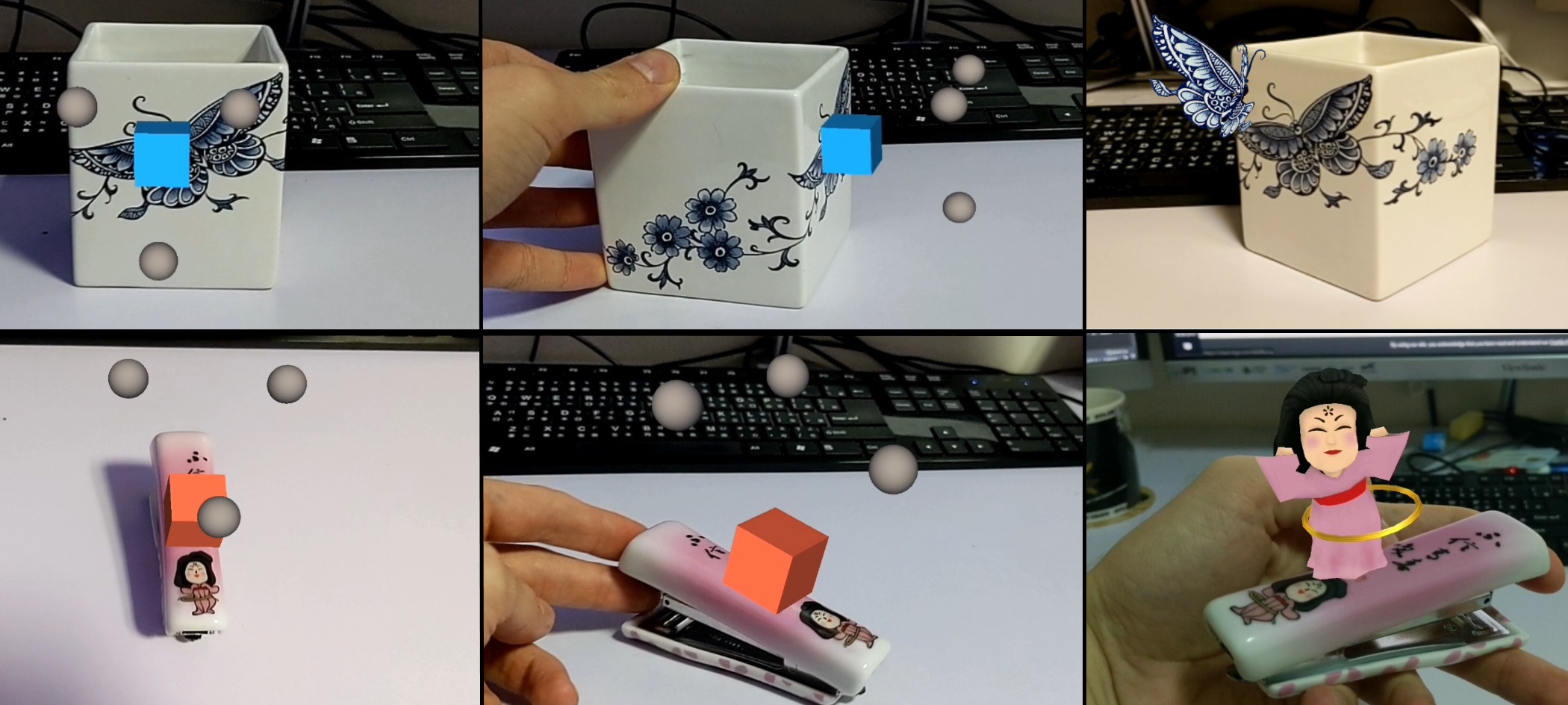

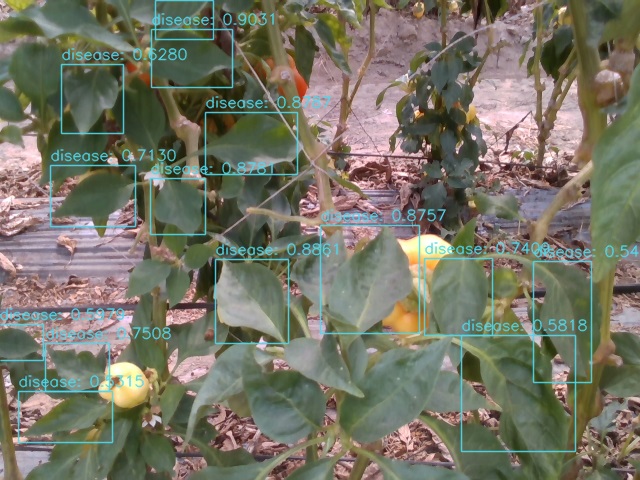

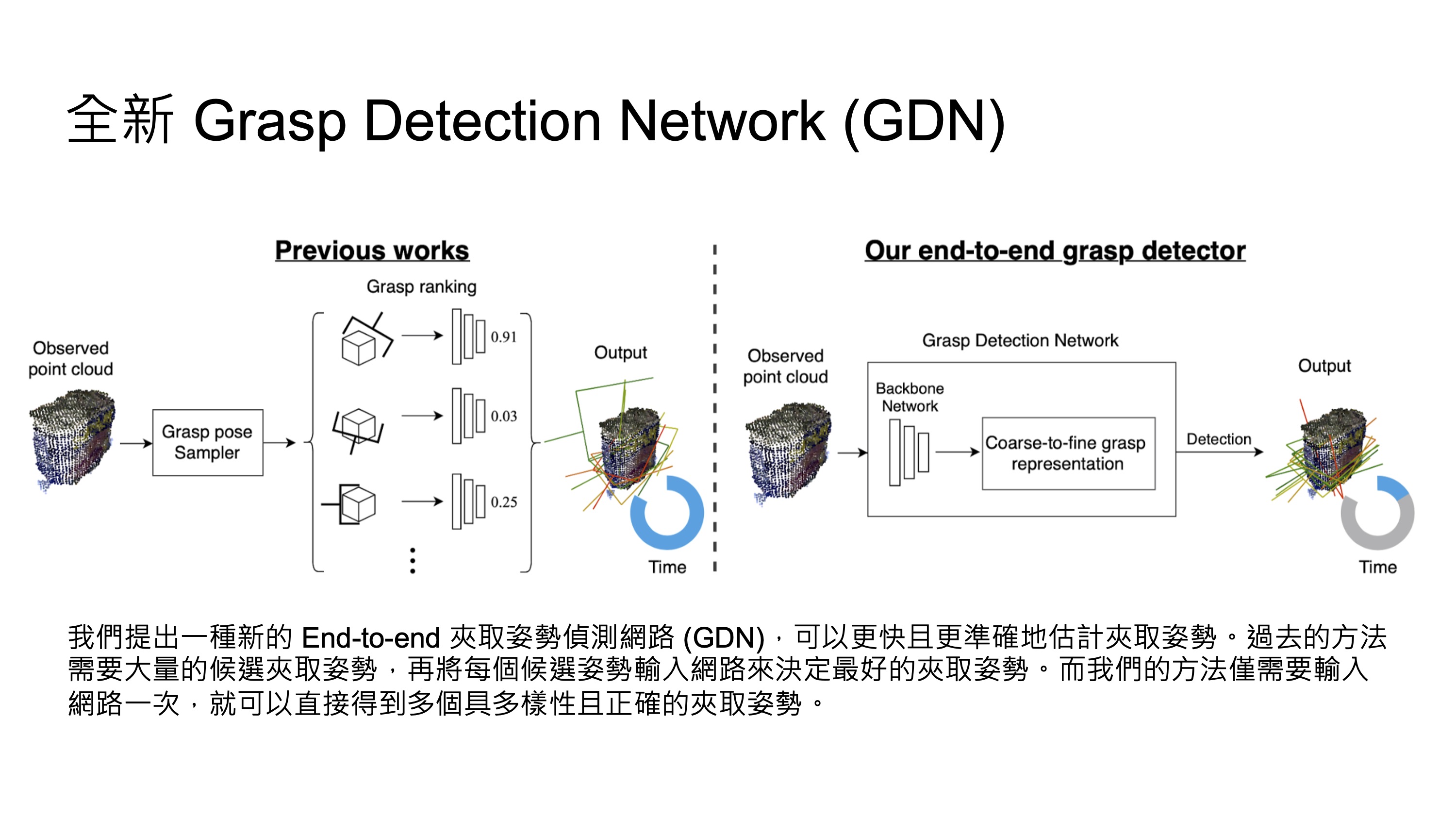

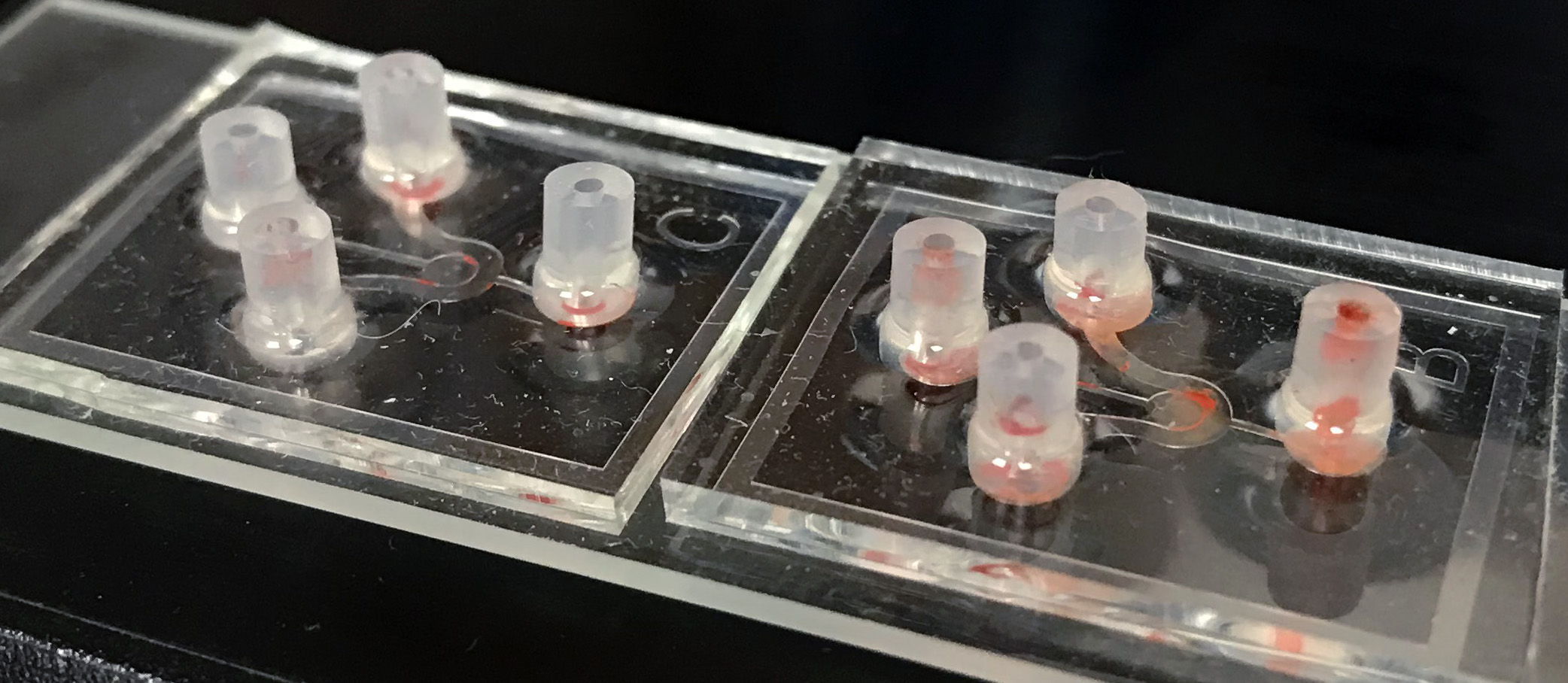

在未來的人機協作環境中,必須以簡便自然的方式操控機械手臂,並克服訓練樣本數過少的問題。本技術開發以自然語言來引導機器手臂抓取任意物件。我們展現三項關鍵技術包括(1)快速準確的3D點雲夾取偵測網路GDN,(2)3D物件指引技術以及全新3D指引資料集,(3)跨領域少量樣本學習。在相關領域呈現極大的進展。 |

| 科學突破性 |

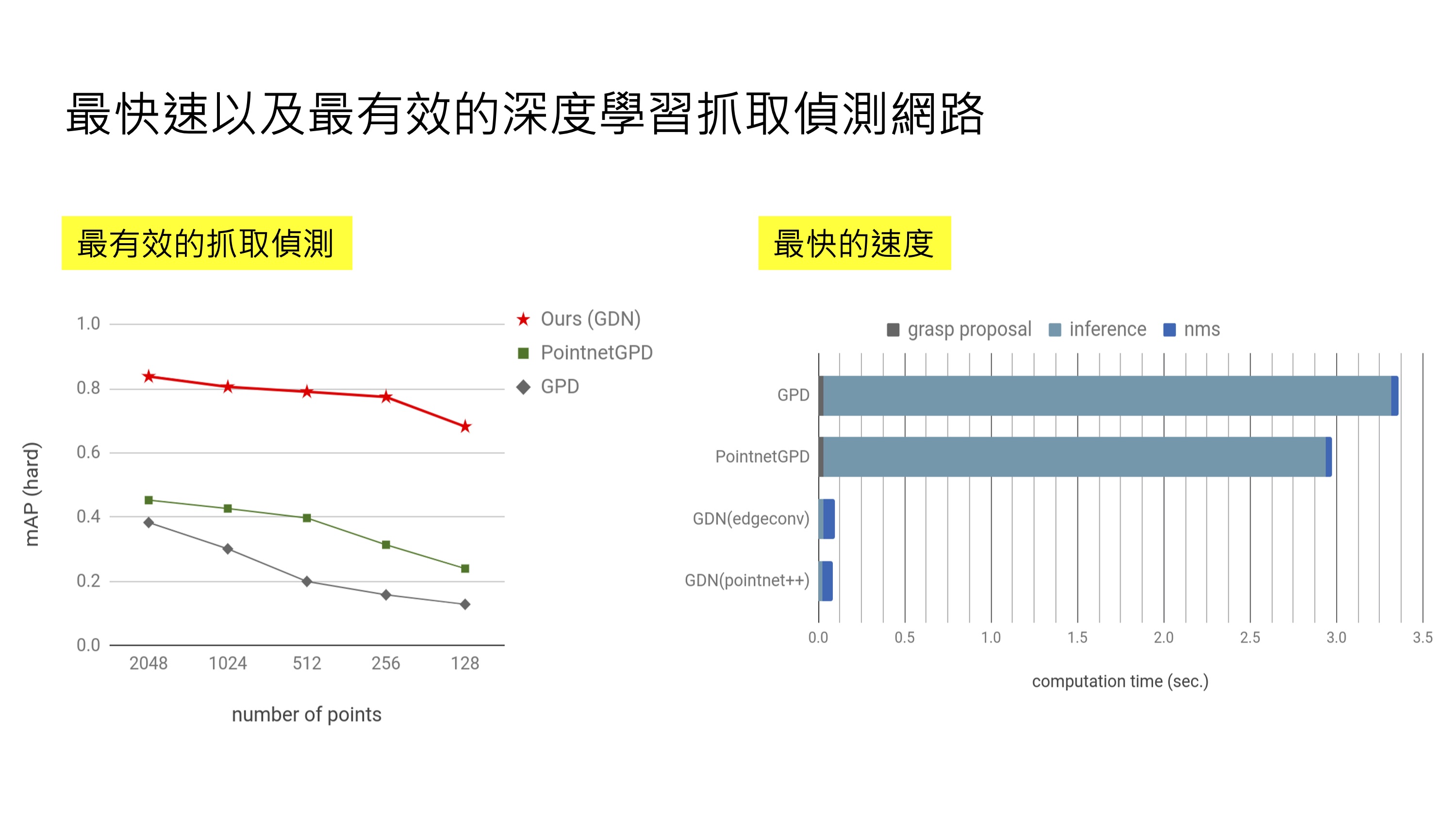

全新3D點雲夾取偵測網路,快速偵測高品質夾取位置,提昇目前學界最好方法約30倍速度,具最佳的夾取成功率,善用3D點雲計算,更能抵抗視覺擷取雜訊。以自然語言引道人機協作,設計全新文字與3D影像共同物件指引深度學習網路,貢獻全新3D物件指引資料集。兼含少量樣本學習技術,並在多個國際競賽中呈現極佳表現。 |

| 產業應用性 |

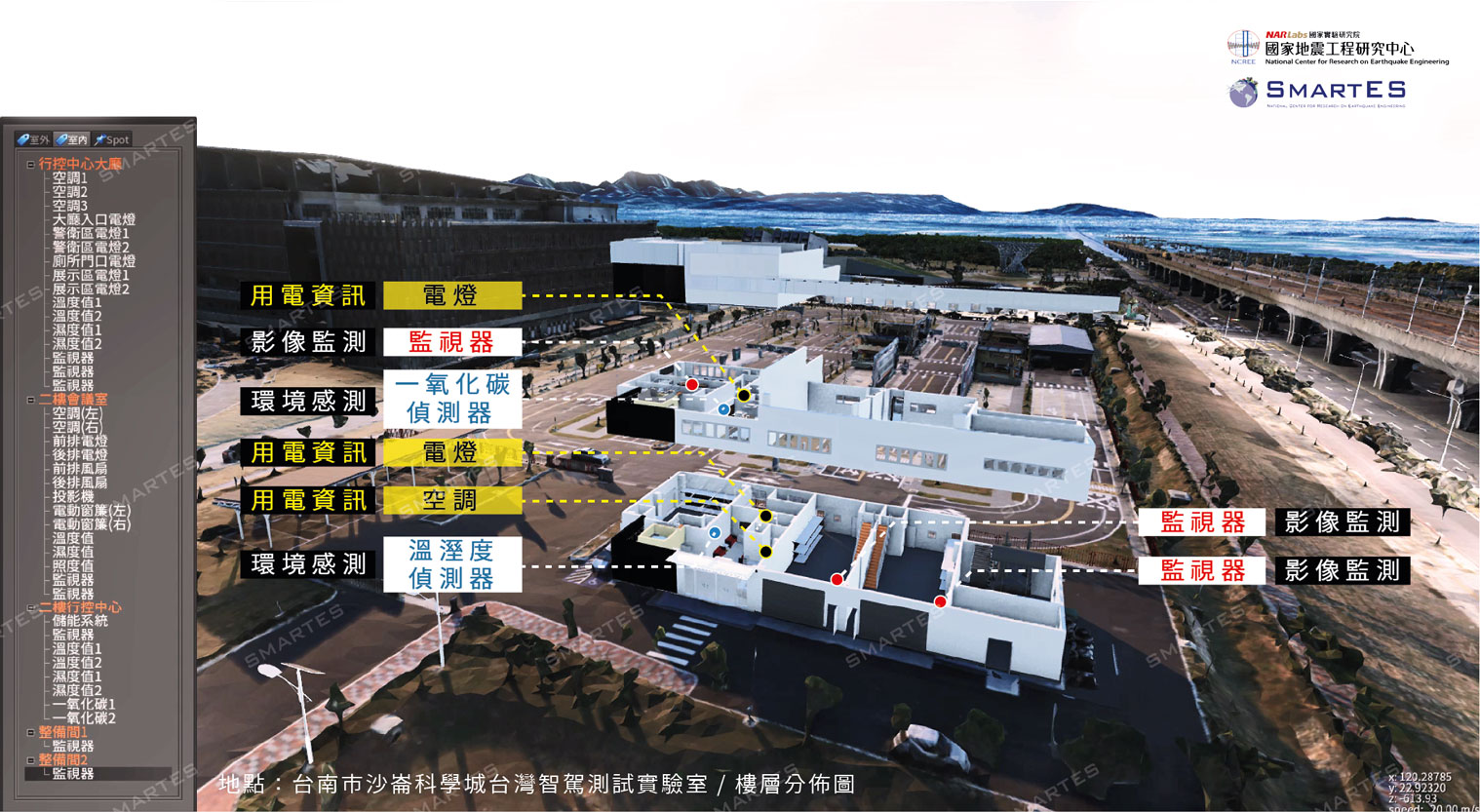

"開發的技術可以讓機器手臂在生產線快速部署,降低訓練時間資料成本。人機共同協作,協助工業4.0落地。語音引導物件指引更可以應用於老人看護、身障人仕服務機器人。其中開發的3D點雲電腦視覺技術更可以使用在自駕車、人臉辨識、機器人感知等前瞻應用。目前部份技術與國內領先資通訊企業持續進行產學合作計畫中。 |

| 媒合需求 |

Our solutions provide 3D vision for accurate 6DoF robotic arm grasping under cluttered scenes with low cost 3D sensors. We provide the most efficient and accurate grasp detection for unseen objects. We further consider few-shot learning for 3D vision for hugely reducing training time and data. |

| 關鍵字 |

機械手臂 夾取點偵測 點雲 立體視覺 抓取 六自由度 深度學習 物件指引 少量樣本學習 跨域學習 |

| 備註 |

在2018年時本團隊也以「大規模無人機物件偵測卷積網路技術」活動未來科技突破將;2020年五月也與科技部長陳良基共通再記者會發表「打破AI黑盒子-可解釋性的人臉辨識模組」;本次展示專注在機器手臂3D視覺以及物件指引,為全新的研究。 |