| 技術名稱 | 互動式物件指引和3D視覺的語音驅動智慧機器手臂取放 | ||

|---|---|---|---|

| 計畫單位 | 國立臺灣大學 | ||

| 計畫主持人 | 徐宏民 | ||

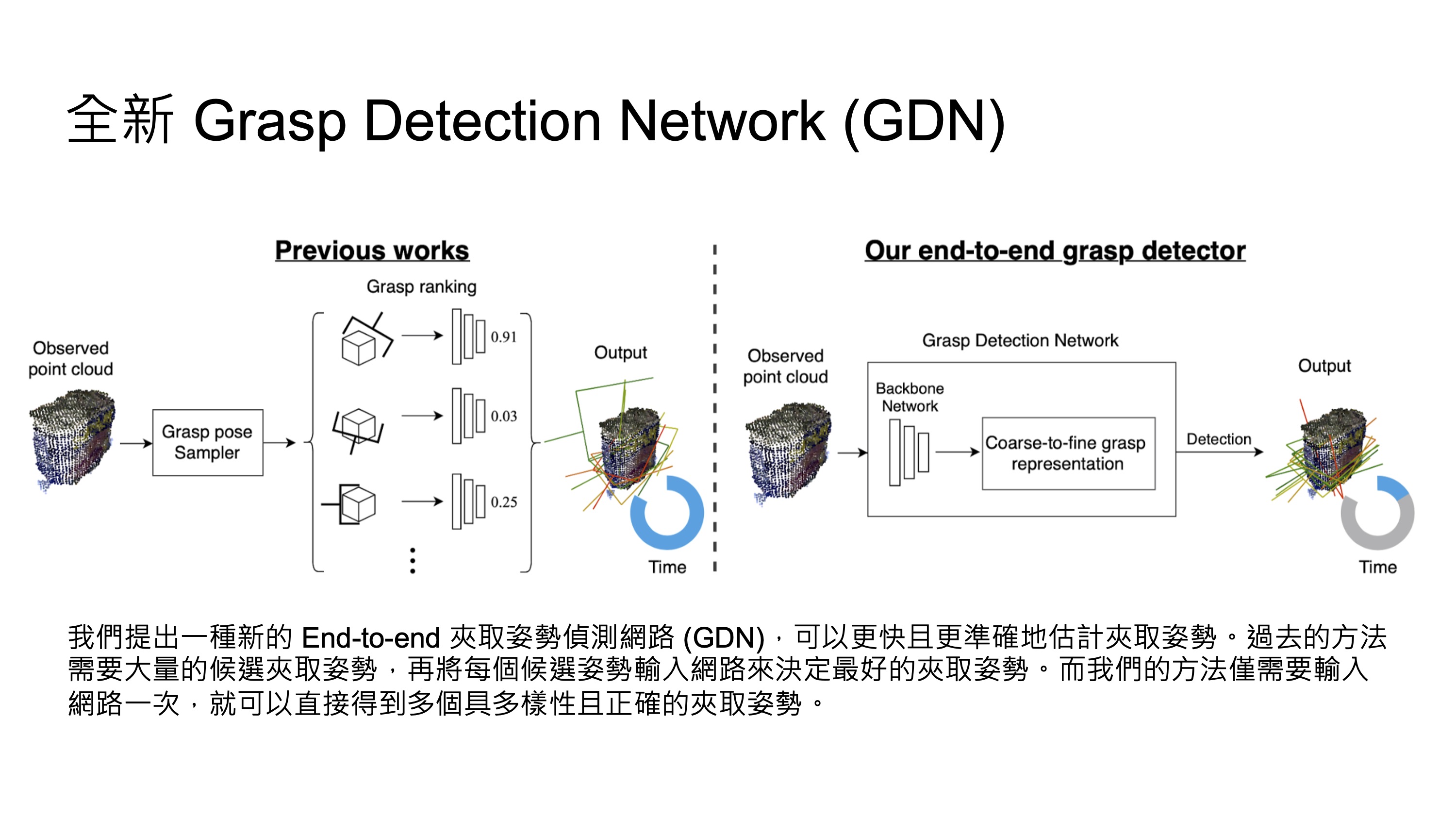

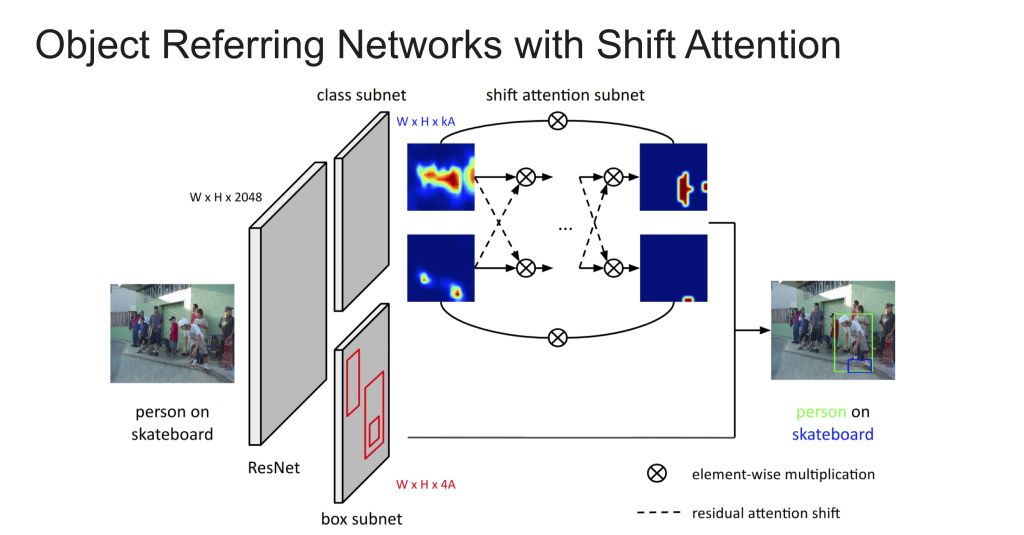

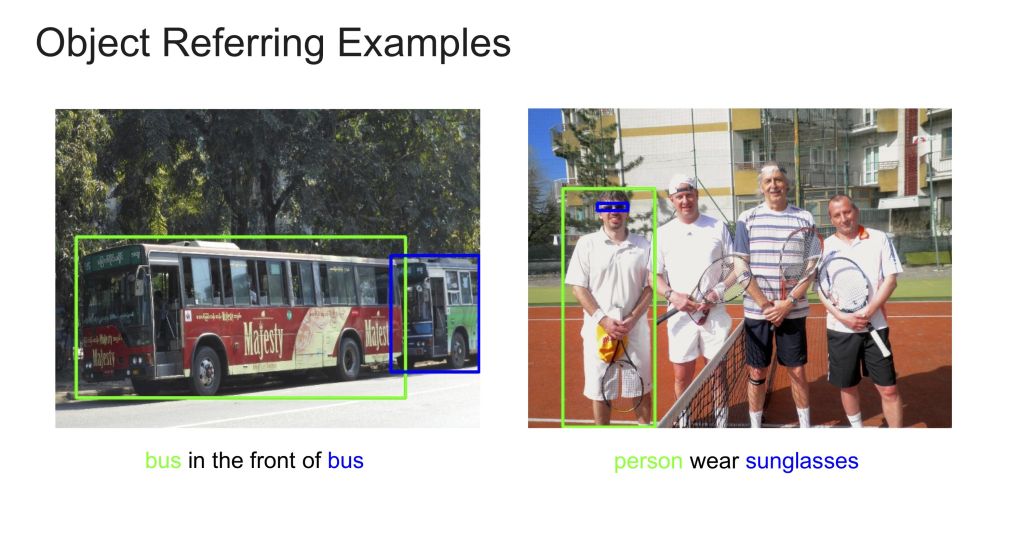

| 技術簡介 | 在未來的人機協作環境中,人類必須以簡便自然的方式操控機械手臂。本技術開發以語音來引導機器手臂抓取任意物件。我們開發了結合語言以及電腦視覺的物件指引深度學習網路,並提出精確的3D電腦視覺技術,利用高效能點雲運算來定位標的,並指示機械手臂抓取;同時考慮少量學習,解決生產線上訓練樣本數太少的問題。此為工業界所期盼的前瞻技術。 |

||

| 科學突破性 | - 提出人機協作最佳技術 |

||

| 產業應用性 | 開發的技術可以讓機器手臂在生產線快速部署,人機共同協作,協助工業4.0落地。語音引導的物件指引更可以應用於老人看護、身障人仕服務機器人。其中開發的立體(點雲)電腦視覺技術更可以使用在自駕車、人臉辨識、機器人感知等前瞻應用。 |

||

| 關鍵字 | 機器手臂 機器人 物件抓取 物件關係 工業4.0 立體視覺 點雲 人機互動 深度學習 物件偵測 | ||

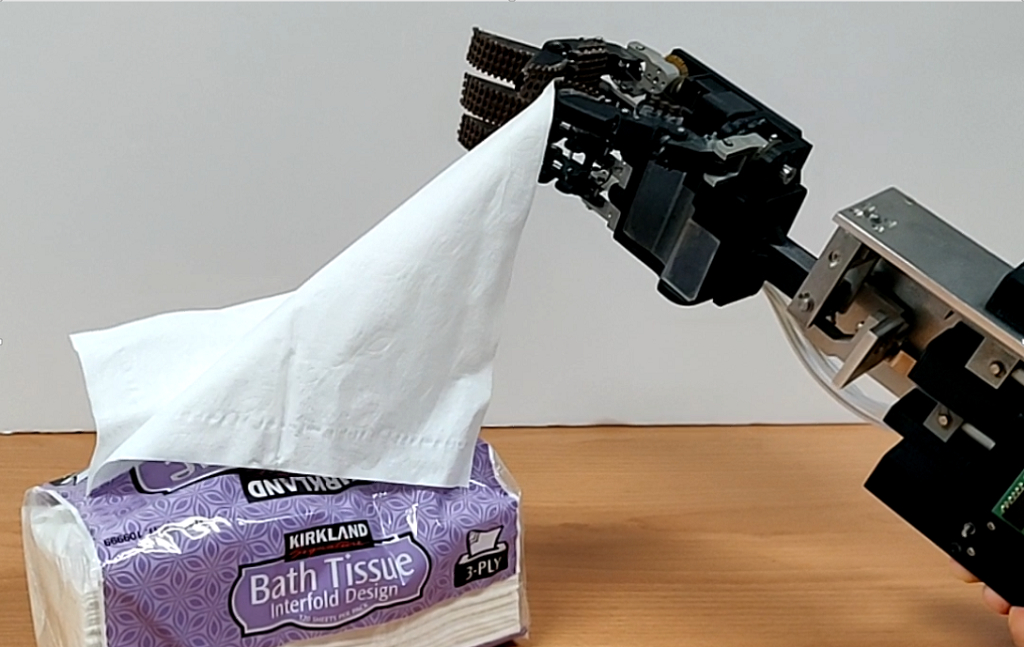

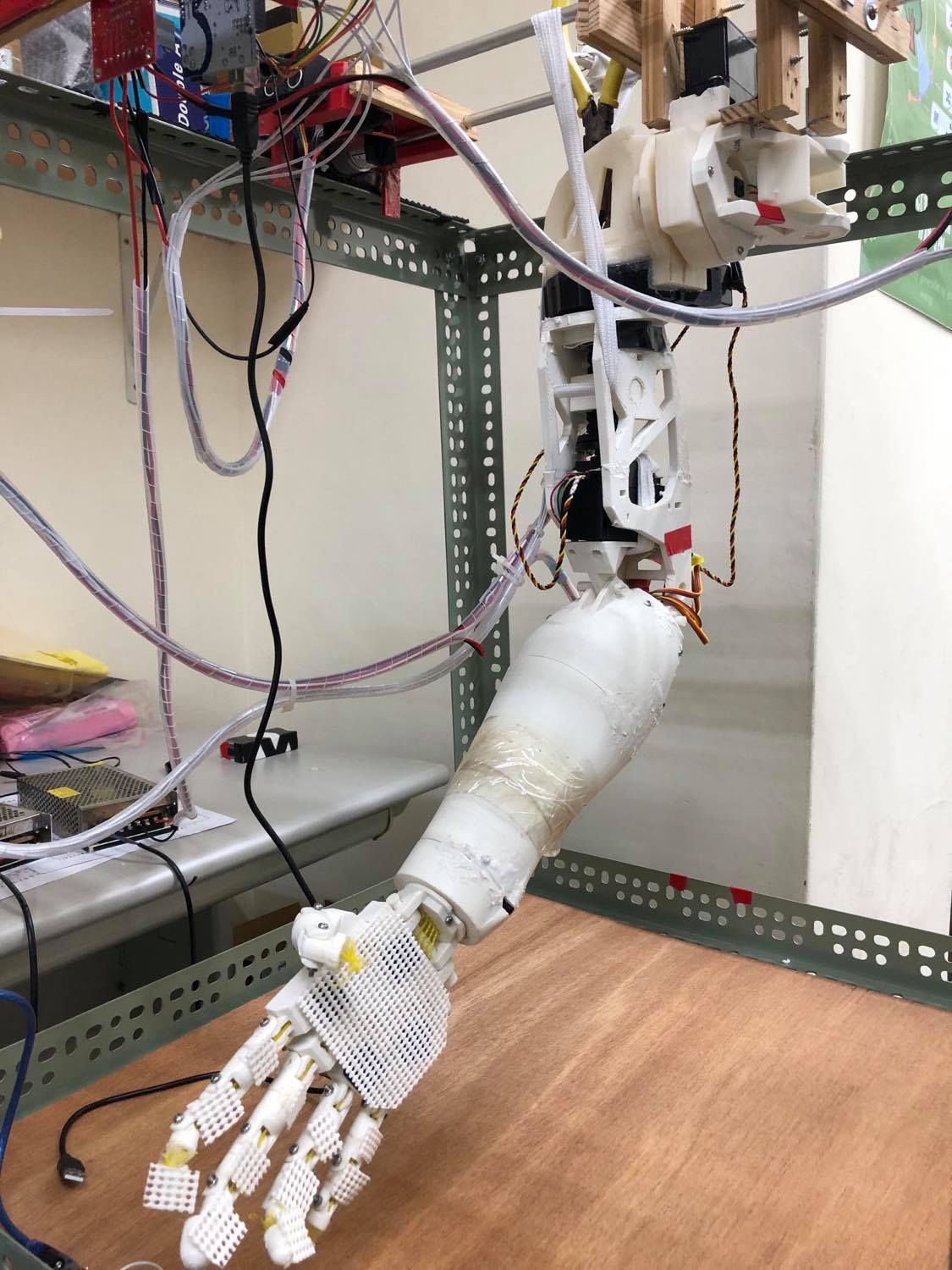

| 備註 | 此部份的機器手臂範例(畫面以及視訊)為示意圖,目前先借用日本公司 Preferred Networks 的類似範例,版權為該公司所有。我們將在十月拍攝本團隊的版本。 |

||

- 聯絡人

- 徐宏民

- 電子信箱

- whsu@ntu.edu.tw

其他人也看了